为什么低温的北方,反而更适合液冷数据中心?

2025.11.06

提到液冷散热,很多人会下意识贴上"南方专属"的标签:毕竟南方夏季动辄35℃+ 的高温,传统空调散热又费电又吃力,液冷的高效导热确实能切中痛点;反观北方,冬天零下十几至三十几度的天然低温,似乎只要打开机房通风,靠内外空气循环就能"免费降温",液冷反而成了"多余选项"。

但真的是这样吗?当数据中心迈入"AI 高密度时代",北方的自然冷却优势,可能藏着你没注意到的短板;而液冷,或已成为北方实现"更低能耗、更高可靠性"的关键选择。

认知误区

北方"自然冷"背后的隐性成本

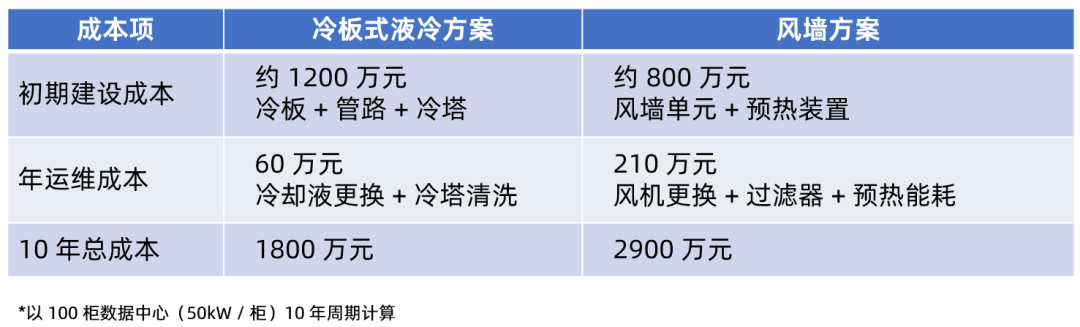

长期以来,"北方靠自然冷就能低成本散热"的认知,建立在"低功率、简单场景"基础上。当数据中心迈入高密度算力时代,北方自然冷却(以风墙技术为代表)的隐性成本逐渐凸显,甚至反超液冷方案:

1. 极端低温下的"预热能耗黑洞"

北方冬季极端低温常达-20℃~-30℃,风墙技术需引入室外冷空气散热,但直接灌入低温空气会导致服务器主板结露(温差超 40℃)、元器件脆化。为规避风险,风墙必须配套电预热装置 —— 单台预热器功率达 5kW / 柜,冬季夜间低温时段(每日 12 小时)持续运行,单柜年额外能耗超 2.16 万度。以北部某 100 柜数据中心为例,仅冬季预热能耗一项,年支出就达 15 万元(按工业电价 0.65 元 / 度计算)。

反观液冷技术,采用防冻冷却液构建封闭循环系统,无需接触室外冷空气。冬季通过室外自然冷却冷塔,-20℃环境下可将冷却液温度降至 10℃~15℃,仅需 80W / 柜的循环泵功耗,单柜年能耗仅 0.7 万度,是风墙预热能耗的 1/3。

2. 高密度场景下的"热岛效率瓶颈"

北方数据中心正加速承载 AI 训练、超算等高密度任务,单柜功率突破 50kW 后,风墙技术的"空气导热"短板暴露无遗:空气导热效率仅 0.026W/(m・K),无法穿透 GPU 集中区域形成的"热岛",导致芯片局部温度超 90℃,触发降频保护(算力利用率从 100% 降至 80%)。为维持算力,企业需额外部署 20% 服务器"堆资源",间接推高设备能耗与采购成本。

液冷技术通过冷板直接贴附 GPU 热源(导热效率 0.6W/(m・K),是空气的 23 倍),单路冷却液即可带走 15kW 热量,8 卡 GPU 集群温度稳定在 70℃±5℃,无降频风险。北部某 AI 实验室数据显示,采用液冷方案后,50kW 机柜的算力输出效率比风墙方案提升 25%,无需额外增配服务器,年设备能耗节省超 30 万元。

3. 沙尘天气下的"运维成本炸弹"

北方春季沙尘暴频发,对风墙技术的过滤系统构成严峻考验:空气过滤器需每 3 天更换一次(单次成本 800 元 / 单元),100 柜数据中心年过滤耗材支出超 96 万元;若更换不及时,沙尘会进入服务器内部,导致风扇卡涩(每月故障 5-8 次)、散热鳍片堵塞(散热效率下降 30%)。2024 年北部某风墙数据中心就因沙尘导致 2 台 GPU 服务器短路,停机 12 小时,直接损失超 50 万元。

液冷系统的封闭循环设计则完全隔绝沙尘:冷却液含防腐蚀添加剂,管路 5 年无锈蚀;冷塔仅需每季度清洗一次(成本 5000 元 / 次),100 柜年运维成本仅 6 万元,是风墙方案的 1/16。

核心逻辑

液冷与北方的"四大适配优势"

实践验证

北极圈的"降本增效"样本

并且,超集信息做的从不只是简单建设。考虑到国际化长途运输中的设备故障风险,为保障后期液冷建设的高效推进,避免直接上线造成整体液冷系统损坏,超集信息在客户本地端建设了"前置验证"液冷测试平台。该平台由多套超集信息自研"风液"CDU组成,保障了项目的稳步推进:

· 精准化检测:通过真实水路循环测试,确认算力设备运输途中无损坏,部件严丝合缝,"零渗漏"接入系统。

· 独立化测试:风液CDU无需接入主液冷管网,单机作战;出现故障不会波及整个液冷系统,安全无忧。

· 批量化检测:单机可承载16 kW热功耗,轻松接入3台8卡GPU服务器或16台CPU服务器,实现批量化高效检测,加速设备上线流程。

随着技术成熟与成本下降,液冷在北方的应用正加速落地。打破"液冷是南方专属"的认知误区,正视液冷与北方气候的适配优势,将成为北方数据中心在新一轮算力竞争中抢占先机的关键。

获取更多液冷智算解决方案及专业技术支持,欢迎垂询"400-860-6560"。超集信息愿与您一起,以极致计算成就极致未来。

声明

我方重申:所有转载的文章、图片、音频视频文件等资料知识产权归权利人所有。但因技术能力有限,无法查得知识产权来源而无法直接与版权人联系授权事宜,若转载内容可能存在引用不当或版权争议,请相关权利方及时通知我们,以便我方迅速删除相关图文内容,避免给双方造成不必要损失。